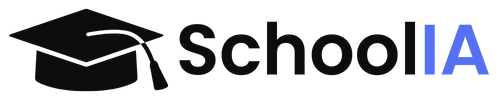

Résumé actionnable en 30 secondes

- Ne partez pas d’un outil. Partez des motifs de contact, des irritants et de la cible d’expérience, puis choisissez où automatiser et où augmenter les conseillers.

- Un assistant conversationnel fiable repose d’abord sur la connaissance : une base de connaissance versionnée, à jour, attribuée à des propriétaires, exploitable via une approche RAG.

- La valeur se pilote avec des KPI reliés au business : déflexion utile, coût par contact, FCR, CSAT, effort client, conversion, churn. Mesurez avant et après, par motif.

- L’industrialisation passe par l’intégration : CRM, ticketing, base d’articles, analytics, et un workflow d’escalade vers l’humain avec transfert du contexte.

- Les garde-fous ne sont pas optionnels : transparence client, périmètre clair, refus de répondre hors sources internes, tests sur cas limites, journalisation, gouvernance légère.

- Roadmap PME 30/60/90 jours : 30 jours de cadrage, 60 jours de pilote maîtrisé, 90 jours d’extension omnicanale et de montée en qualité.

Introduction

Entre les volumes qui augmentent, les attentes d’immédiateté et l’exigence d’une expérience cohérente sur tous les canaux, la relation client des PME arrive à un point de tension. Les assistants conversationnels et l’IA générative promettent de répondre plus vite, de mieux orienter les demandes et de soulager les équipes. Mais dans la réalité, un « bot » mal cadré peut créer l’effet inverse : réponses incohérentes, escalades tardives, informations obsolètes, frustration et perte de confiance.

La thèse est simple : un assistant conversationnel n’est pas un widget. C’est un système socio-technique qui combine connaissance, intégrations, règles métiers, supervision et conduite du changement. Les analyses de cabinets comme McKinsey et les signaux marché relayés par Gartner soulignent l’accélération des pilotes. La différence, pour une PME, se joue sur une méthode d’accompagnement IA structurée : choisir les bons cas d’usage, construire une architecture robuste, mesurer le ROI sans se tromper, et sécuriser la confiance.

Pourquoi les assistants conversationnels changent la relation client

Ce qui évolue côté clients

- Instantanéité : obtenir une réponse maintenant, même en dehors des horaires.

- Self-service guidé : résoudre seul, mais avec un accompagnement intelligent.

- Continuité : ne pas répéter son histoire entre email, chat et téléphone.

- Personnalisation raisonnable : être reconnu et orienté selon son contexte, sans impression de surveillance.

- Transparence : savoir si l’on parle à une IA, et comprendre quand cela bascule vers un humain.

Ce qui évolue côté entreprises

| Avant | Après |

|---|---|

| Organisation : des équipes et scripts par canal. | Organisation : une orchestration omnicanale et des règles d’escalade communes. |

| Connaissance : une FAQ publique et des réponses « dans la tête » des conseillers. | Connaissance : une base de connaissance vivante, gouvernée, réutilisable par l’IA et par les équipes. |

| Rôle des conseillers : répondre à tout. | Rôle des conseillers : traiter l’ambigu, le sensible et le complexe, avec un copilote qui prépare, résume et suggère. |

| Pilotage qualité : pilotage surtout par volumes et délais. | Pilotage qualité : pilotage par qualité de résolution, traçabilité, conformité et satisfaction par motif. |

Le vrai sujet n’est pas le canal, c’est la connaissance et l’orchestration

Un même client attend une réponse identique, qu’il écrive un email, qu’il chat sur le site, qu’il appelle ou qu’il consulte une FAQ. Si vos réponses diffèrent selon le canal, le problème n’est pas l’IA, c’est l’absence de source de vérité et de règles d’orchestration. Exemple concret : une politique de retour change. Si elle est mise à jour sur le site mais pas dans les scripts d’appel ni dans la base d’articles, l’assistant (et parfois même l’humain) va diverger. La stratégie IA relation client consiste donc à harmoniser la connaissance, puis à orchestrer qui répond, quand, et avec quel niveau de preuve.

Clarifier le vocabulaire pour décider plus vite

Chatbot, voicebot, agent IA, copilote conseiller

| Objet | Où il agit | Ce qu’il sait faire | Pertinent en PME | Risques typiques |

|---|---|---|---|---|

| Conversation textuelle | Chat site, messagerie | Répondre, orienter, collecter | Top motifs simples et visibles | Réponses vagues, mauvais routage, FAQ obsolète |

| Conversation vocale | Téléphonie | Accueil, qualification, collecte, statut | Pics d’appels, accueil standardisé | Incompréhension, irritant si pas d’issue vers humain |

| Automatisation d’actions | Front et parfois back office | Enchaîner des actions via outils | Quand les intégrations sont prêtes | Actions incorrectes, effets de bord, sécurité |

| Assistance aux conseillers | Poste de travail des équipes | Suggérer, résumer, rédiger, retrouver la bonne info | Démarrage rapide avec risque client réduit | Surconfiance, absence de validation, style de marque incohérent |

Dans beaucoup de PME, le meilleur point de départ n’est pas forcément un assistant « face client » (Utilisation de ChatGPT pour les entreprises : guide complet). Un copilote interne crée souvent de la valeur plus vite, tout en laissant un humain responsable du dernier kilomètre.

Automatiser ou augmenter

- Automatiser si : demandes répétitives, risque faible, information stable, règles claires, escalade simple et rapide.

- Augmenter si : cas ambigus, charge émotionnelle, enjeu business élevé, besoin de jugement, contexte client complexe.

- Doute fréquent : si le motif est fréquent mais risqué, commencez par augmenter, puis automatisez après stabilisation des réponses et des garde-fous.

RAG et base de connaissance

Le RAG est une approche qui fait répondre un modèle à partir de vos contenus, plutôt qu’à partir de sa « mémoire » générale. Concrètement, l’assistant recherche d’abord des passages pertinents dans votre base de connaissance, puis il rédige la réponse en s’appuyant sur ces passages. Cela ne supprime pas tous les risques, mais cela rend les réponses plus contrôlables, plus explicables et plus faciles à mettre à jour. Le RAG oblige aussi à clarifier quelles sources sont autorisées et comment elles sont maintenues. Si vous vous posez la question du cadre d’usage en interne, ce guide sur l’utilisation de ChatGPT en entreprise peut compléter la réflexion.

- Réduit les erreurs liées à des informations génériques ou datées.

- Améliore la traçabilité, car on sait quel contenu a servi de base.

- Facilite la mise à jour, car on corrige la source, pas mille scripts.

- Permet de cadrer le périmètre, en limitant la réponse aux contenus validés.

Partir des motifs de contact, pas de la techno

Cartographier les demandes sur 30 jours

- Exportez 30 jours de tickets, emails, chats, motifs d’appels et tags, même imparfaits.

- Regroupez en une liste de motifs, puis isolez votre top 20 par volume.

- Pour chaque motif, notez le volume, le temps moyen de traitement, les causes de réitération, et les irritants fréquents.

- Classez le risque, en distinguant risque client, risque juridique, risque réputationnel et risque financier.

- Identifiez la donnée nécessaire pour répondre juste : article interne, état de commande, politique commerciale, historique client, statut de paiement, etc.

- Repérez les motifs qui échouent surtout par manque de connaissance, et ceux qui échouent par manque d’intégration.

Ce travail, souvent négligé, crée une base commune entre direction, service client, commerce et IT. Il évite de « sur-automatiser » des sujets qui nécessitent d’abord de clarifier vos règles et vos contenus. Si vous voulez accélérer ce cadrage sans alourdir l’organisation, un atelier de cadrage IA permet généralement d’aligner motifs, données et garde-fous dès le départ.

Identifier les irritants à fort impact

- Irritant : réponses différentes selon le canal ; cause : sources multiples ; donnée manquante : source de vérité ; action : une base unique d’articles validés.

- Irritant : relances répétées des clients ; cause : manque de statut ; donnée manquante : événement opérationnel ; action : intégrer un suivi de dossier simple dans l’assistant.

- Irritant : escalade tardive ; cause : bot trop « confiant » ; donnée manquante : règles d’abandon et seuils ; action : définir des triggers d’escalade et un transfert de contexte.

- Irritant : promesses commerciales contradictoires ; cause : offres non maîtrisées ; donnée manquante : catalogue et règles ; action : cadrer la vente assistée et les limites de discours.

Définir une cible d’expérience

- Ton de marque : vocabulaire autorisé, niveau de formalité, phrases interdites, posture en cas d’erreur.

- Niveau d’autonomie du client : simple orientation, résolution complète, ou résolution avec confirmation finale.

- Règles d’escalade : quand, vers qui, avec quel contexte transmis, et sous quel délai attendu.

- Transparence IA : annonce explicite, rappel en cas de transfert, et consignes en cas d’incertitude.

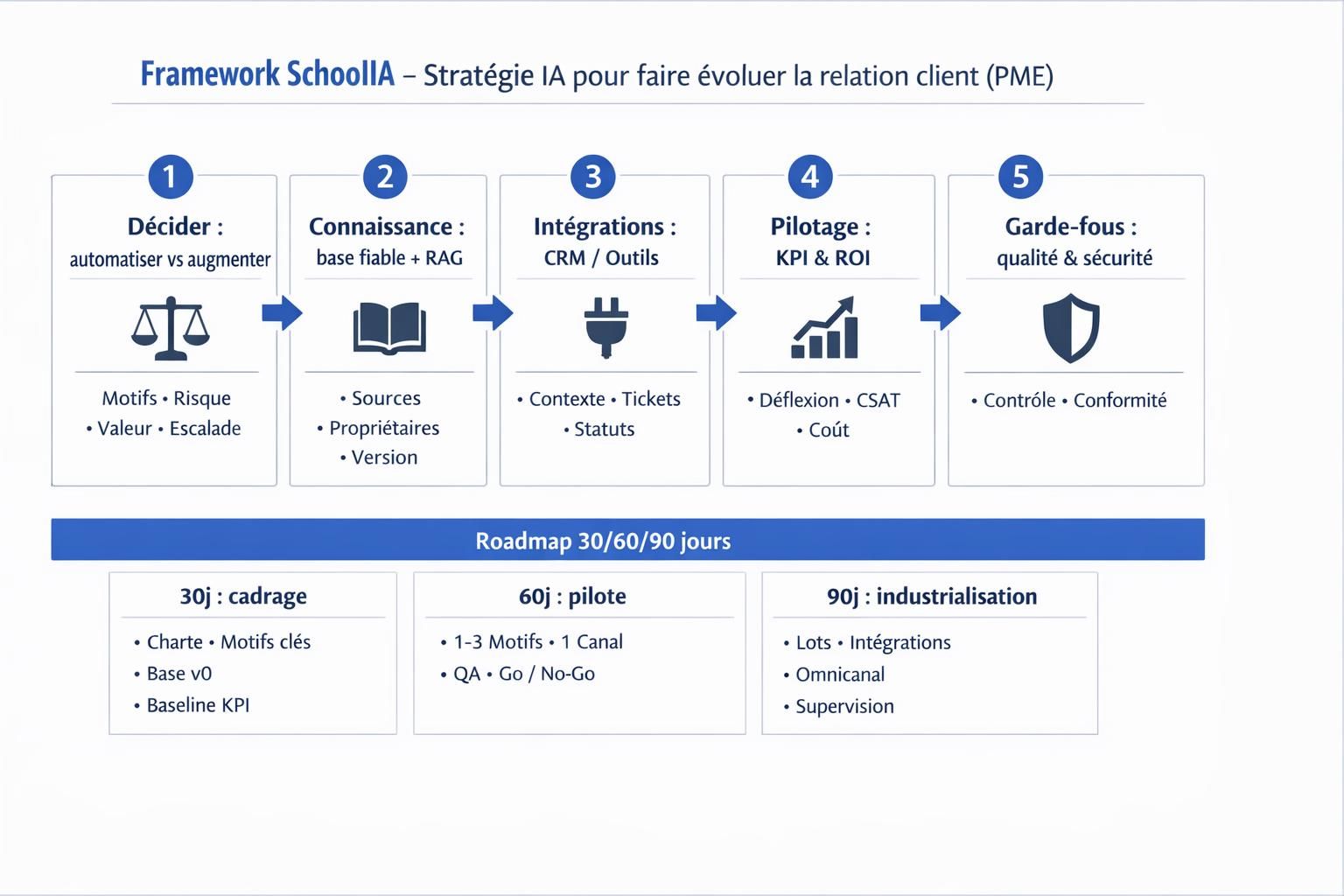

Prioriser les cas d’usage avec une matrice impact effort risque

Les 10 cas d’usage les plus rentables en PME

- 1. FAQ dynamique et recherche assistée pour trouver vite la bonne réponse.

- 2. Suivi de commande ou de dossier avec récupération de statut via vos outils.

- 3. Qualification et routage de tickets pour envoyer au bon interlocuteur dès le départ.

- 4. Réponses email assistées pour accélérer la production de réponses cohérentes.

- 5. Résumé de conversation et compte rendu CRM pour réduire l’administratif.

- 6. Suggestions de réponses pour conseillers avec accès à la base de connaissance.

- 7. Détection d’intention et d’urgence pour prioriser et éviter l’escalade tardive.

- 8. Collecte d’informations avant rappel pour gagner du temps sur l’appel.

- 9. Relances proactives sur événements, avec règles strictes et consentement.

- 10. Aide à la vente et cross-sell encadré, seulement sur périmètre maîtrisé.

Matrice de priorisation SchoolIA

Pour prioriser sans débat infini, scorez chaque cas d’usage de 1 à 5 sur six critères. La règle simple : on cherche des cas à fort impact client et coûts, avec complexité data modérée et risque faible au départ. Vous obtenez généralement 3 quick wins et 2 chantiers structurants à lancer en parallèle.

| Critères |

|---|

| Impact client |

| Impact coûts |

| Complexité data |

| Risque réputationnel |

| Risque conformité |

| Temps de mise en œuvre |

| Exemples de scoring | Impact client | Impact coûts | Complexité data | Risque réputationnel | Risque conformité | Temps de mise en œuvre | Total |

|---|---|---|---|---|---|---|---|

| FAQ dynamique | 4 | 3 | 2 | 2 | 2 | 2 | 15 |

| Routage de tickets | 3 | 4 | 3 | 2 | 2 | 3 | 17 |

| Réponses email assistées | 3 | 4 | 2 | 2 | 3 | 2 | 16 |

| Vente assistée | 3 | 2 | 4 | 4 | 3 | 4 | 20 |

| Réclamations sensibles en autonomie | 5 | 3 | 4 | 5 | 4 | 4 | 25 |

Interprétez le total comme un repère de comparaison, puis relisez les colonnes « risques » avant de valider l’ordre de déploiement. Si un cas est très rentable mais trop risqué au début, transformez-le en copilote interne ou réduisez son périmètre.

Sortie attendue : choisissez 3 quick wins centrés sur la connaissance et le tri, et 2 chantiers structurants centrés sur l’intégration et la gouvernance de contenu.

Les cas à éviter au début

- Traiter des réclamations sensibles en autonomie sans supervision et sans escalade immédiate.

- Prendre des décisions engageantes sans validation humaine, comme valider un remboursement ou une exception commerciale.

- Faire des promesses commerciales non maîtrisées, surtout si les règles varient selon client ou canal.

- Laisser l’assistant répondre hors périmètre, sans sources internes et sans mécanisme de refus.

- Lancer omnicanal dès le jour 1, au lieu de stabiliser un périmètre pilote.

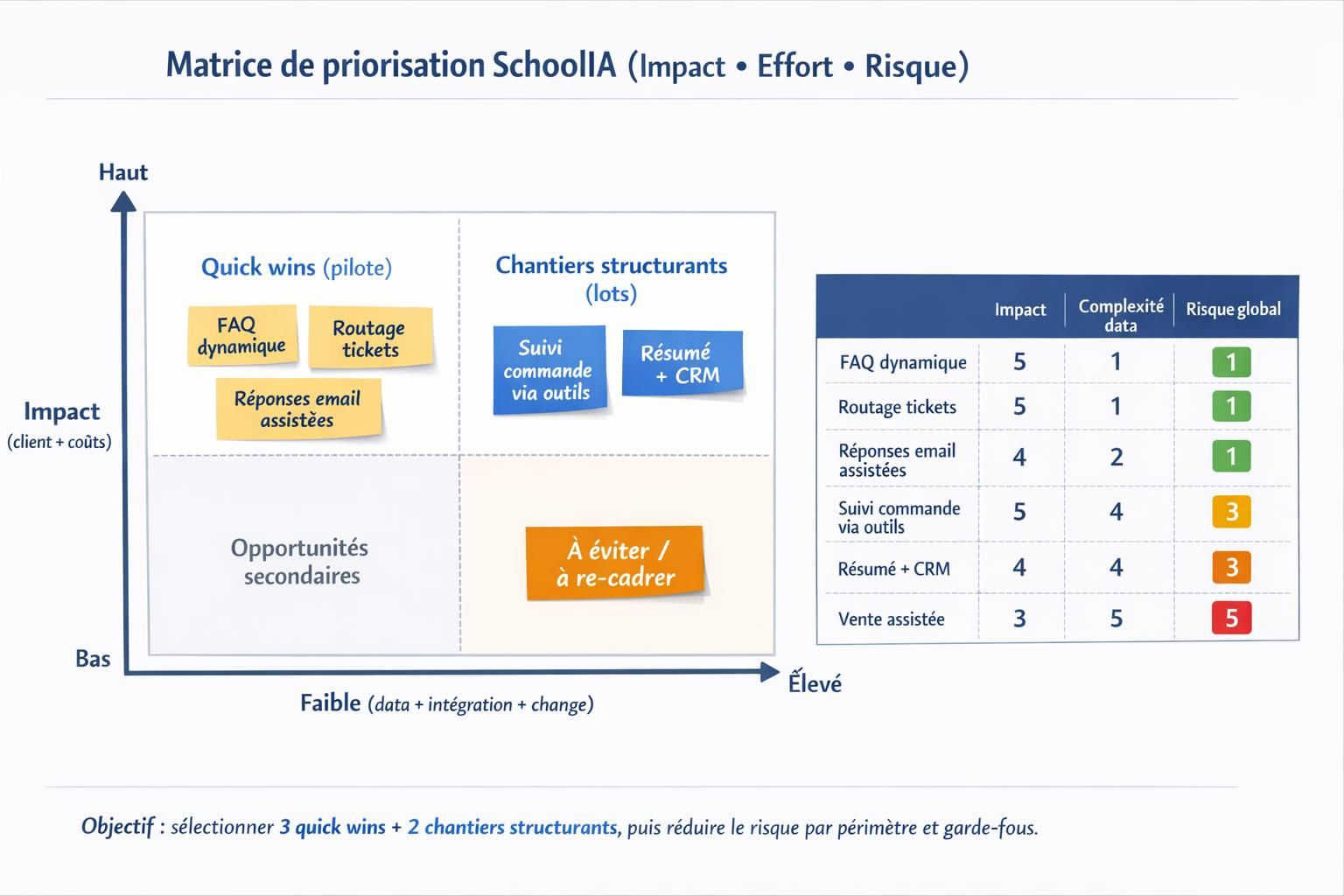

Concevoir l’architecture qui tient en production

Les briques indispensables

Une architecture robuste en PME peut rester simple si elle est bien pensée. L’idée est de séparer la conversation, la connaissance et les systèmes métiers, puis de tout observer. Cela évite qu’un changement de contenu casse l’expérience, et cela rend vos décisions mesurables.

- Canaux : site, messageries, email, téléphone selon vos priorités.

- Orchestrateur conversationnel : gère les parcours, les règles, l’escalade, la collecte et les handoffs.

- Base de connaissance : articles, procédures, politiques, scripts, FAQ internes validées.

- Modèle de langage : génère et reformule, sous contraintes et règles.

- RAG : recherche dans les contenus autorisés et injection de contexte dans la réponse.

- Outils métier : CRM, ticketing, ERP, expédition, facturation selon votre activité.

- Journalisation et monitoring : logs, évaluations qualité, alertes, analyse des échecs.

Exigences de données pour un assistant fiable

- Sources autorisées : liste explicite de documents et systèmes consultables par l’assistant.

- Propriétaire par contenu : une personne ou un rôle responsable de chaque famille d’articles.

- Date de mise à jour : affichée, avec règle de revue périodique.

- Versioning : historique des changements et possibilité de revenir en arrière.

- FAQ internes validées : réponses courtes, non ambiguës, alignées sur vos politiques.

- Gestion des exceptions : quoi faire quand le cas n’entre pas dans les règles.

- Langage et ton : cohérence avec votre marque et vos obligations d’information.

Si votre base de connaissance n’est pas fiable, l’assistant ne le sera pas. C’est souvent le principal chantier, et aussi celui qui crée le plus de valeur long terme.

Intégrations prioritaires en PME

| Outil | Bénéfice | Prérequis |

|---|---|---|

| CRM | Contexte client et personnalisation raisonnable | Données propres, champs utiles, droits d’accès |

| Ticketing | Création, mise à jour, escalade et suivi | Catégories de motifs, règles de routage, SLA |

| Base articles | Source de vérité pour le RAG | Gouvernance, format homogène, validation |

| Téléphonie | Qualification avant transfert, réduction des appels inutiles | Parcours d’accueil, consentements, scripts |

| Analytics | Mesurer la déflexion utile, la qualité et la satisfaction | Événements, tagging des motifs, tableau de bord |

Pour structurer ces intégrations et vos automatisations (sans complexifier inutilement), la Formation Automatisation IA & No-Code aide à cadrer les bons flux et les bons garde-fous côté PME.

Orchestration bot vers humain

- Reconnaître la limite : faible confiance, demande hors périmètre, émotion, urgence, ou donnée manquante.

- Reformuler : vérifier l’intention, proposer une ou deux options, éviter le ping-pong.

- Proposer le transfert : expliquer pourquoi et ce qui va se passer ensuite.

- Passer le contexte au conseiller : motif, résumé, informations collectées, sources consultées, tentative de résolution.

- Clôture et feedback : demander si la réponse a aidé, et taguer l’échec pour amélioration.

Mettre des garde-fous qualité, sécurité et conformité

Transparence et information client

La Commission européenne, via l’AI Act, ancre une logique de transparence et de gestion des risques. Sans entrer dans l’interprétation juridique, retenez un principe opérationnel : un client doit comprendre quand il interagit avec une IA et comment obtenir un humain. La clarté augmente la confiance et réduit les situations de blocage. Pour un ancrage institutionnel, vous pouvez vous référer à la page Commission européenne « AI Act enters into force ».

- Exemple 1 : Vous échangez avec un assistant IA. Je peux vous aider sur les questions standard et transférer à un conseiller si besoin.

- Exemple 2 : Je peux me tromper. Si votre demande est urgente ou sensible, dites « conseiller » pour être mis en relation.

- Exemple 3 : Pour répondre, je m’appuie sur notre base d’articles interne. Si je ne trouve pas une information fiable, je crée un ticket.

En pratique, la FAQ de l’AI Act Service Desk peut aussi aider à traduire ces principes en réflexes côté déployeur, notamment sur l’explicitation et la montée en compétence des équipes.

Réduire les réponses fausses et hors périmètre

Les cadres NIST AI Risk Management Framework (AI RMF 1.0) et NIST Generative AI Profile (AI 600-1) proposent une approche pragmatique : identifier les risques, les mesurer, les manager, et installer une gouvernance. Appliqué à un assistant relation client, cela se traduit par des garde-fous concrets et testables.

- Répondre uniquement à partir de sources internes autorisées, avec refus explicite hors périmètre.

- Dire je ne sais pas, puis proposer une action utile : créer un ticket, demander une précision, transférer.

- Filtrer les contenus sensibles et définir des sujets interdits ou toujours escaladés.

- Tester sur scénarios limites : cas ambigus, informations contradictoires, demandes agressives, tentatives de contournement.

- Mettre des règles sur la forme : pas d’engagement contractuel, pas de promesse de délai non vérifiée, pas de conseil juridique ou médical.

- Superviser en continu : échantillonner des conversations, taguer les erreurs, corriger la source et réentraîner le parcours.

Gouvernance légère mais réelle pour PME

Vous n’avez pas besoin d’une usine à gaz. En revanche, vous avez besoin de responsabilités claires. Lorsque l’assistant devient un actif critique, ISO 42001 est un repère utile pour penser en système de management, sans viser une conformité formelle.

| Activités clés | Owner relation client | Référent métier | IT ou prestataire | DPO ou référent RGPD | Responsable base de connaissance |

|---|---|---|---|---|---|

| Objectifs et KPI | A | C | C | C | C |

| Contenus et règles métiers | A | R | I | C | R |

| Intégrations, accès et sécurité | C | C | A | C | I |

| RGPD et minimisation des données | C | I | C | A | I |

| QA, supervision et amélioration continue | A | R | C | C | R |

Journalisation, supervision et amélioration continue

- Collecter : logs, motifs, escalades, verbatims, sources consultées, issues.

- Évaluer : échantillons hebdomadaires, qualité perçue, conformité, erreurs factuelles.

- Corriger : mise à jour des articles, règles, parcours, déclencheurs d’escalade.

- Déployer : versions contrôlées, tests de non-régression sur scénarios critiques.

- Former : retours aux équipes, bibliothèques de bonnes réponses, alignement ton et posture.

- Re-mesurer : comparaison avant après, par motif, et analyse des effets secondaires.

Mesurer la valeur avec les bons KPI et une méthode ROI simple

KPI par objectif

| Objectif | KPI clés |

|---|---|

| Réduction des coûts | taux de déflexion réel, coût par contact, AHT, taux d’automatisation |

| Qualité | FCR, taux d’escalade, taux d’erreur détectée, conformité aux règles |

| Satisfaction | CSAT, NPS, effort client, taux d’abandon sur parcours bot |

| Business | conversion, panier moyen, churn, taux de réachat, taux de prise de rendez-vous |

Un bon KPI est actionnable. Si vous ne savez pas quelle décision vous prendrez quand il monte ou baisse, il n’est pas prioritaire.

Méthode avant après sans se tromper

- Étape 1 : définissez une baseline sur 2 à 4 semaines, avant déploiement.

- Étape 2 : segmentez par motif, pas seulement par canal.

- Étape 3 : mesurez la déflexion utile, c’est-à-dire les demandes réellement résolues sans réitération.

- Étape 4 : contrôlez les effets secondaires : augmentation des réitérations, baisse de CSAT, escalades plus longues.

- Étape 5 : comparez des périodes et des populations comparables, et documentez les changements de process.

- Étape 6 : reliez les gains à un levier clair : réduction d’AHT, baisse de contacts, amélioration FCR, hausse conversion.

Exemple de tableau de pilotage hebdomadaire

| Rubrique | Champs à renseigner |

|---|---|

| Périmètre | Canaux couverts, motifs couverts, version assistant |

| Volume | Nombre d’interactions, top motifs, part escaladée |

| Efficacité | Déflexion utile, AHT humain sur motifs couverts, création de tickets |

| Qualité | FCR par motif, erreurs factuelles détectées, réponses hors périmètre |

| Expérience | CSAT et effort client sur parcours assistant, verbatims négatifs récurrents |

| Conformité | Incidents, demandes sensibles, respect des règles d’information |

| Plan d’action | 3 corrections de contenu, 2 ajustements de parcours, 1 test sur scénario limite |

Roadmap PME en 30/60/90 jours

30 jours cadrage et préparation

- Charte conversationnelle : ton, limites, transparence, posture en cas d’incertitude.

- Top motifs : cartographie, volumes, irritants, risques, données requises.

- Base de connaissance v0 : sources autorisées, articles prioritaires, propriétaires, versioning.

- Règles d’escalade : triggers, transfert de contexte, SLA interne, scripts conseillers.

- KPI baseline : définition, collecte, segmentation par motif, fréquence de pilotage.

60 jours pilote sur un périmètre maîtrisé

- Choisir 1 à 3 motifs simples, à faible risque, à forte volumétrie.

- Déployer sur un canal principal, avec escalade humaine fluide.

- Mettre en place l’évaluation qualité : échantillonnage, critères, tags d’erreurs.

- Critères go/no-go : stabilité des réponses, baisse des réitérations, CSAT non dégradé, escalade fonctionnelle, conformité respectée.

90 jours industrialisation et extension omnicanale

- Lot 1 : extension à de nouveaux motifs proches, en réutilisant la même base de connaissance.

- Lot 2 : intégrations prioritaires : ticketing puis CRM, selon la maturité de données.

- Lot 3 : extension à un second canal, en conservant les mêmes règles et la même source de vérité.

- Lot 4 : outillage de supervision : tableaux de bord, alertes, tests automatisés sur scénarios critiques.

Formation et conduite du changement

- Clarifier les rôles : ce que l’assistant fait, ce que le conseiller fait, et comment se fait la responsabilité.

- Travailler les scripts : phrases d’escalade, reformulations, confirmations, réponses types.

- Installer une routine QA : revue hebdomadaire de conversations et de corrections.

- Former à l’usage : prompting opérationnel, limites, vérifications, bonnes pratiques de rédaction. Pour professionnaliser l’usage côté équipes, la formation IA pour le service client et le support aide à ancrer les bons réflexes.

- Mettre un rituel hebdomadaire : KPI, apprentissages, backlog de contenus, décisions de périmètre.

Erreurs fréquentes et bonnes pratiques

Les 7 erreurs qui dégradent l’expérience client

- Erreur : lancer sans base de connaissance gouvernée ; correction : créer une source de vérité priorisée et versionnée.

- Erreur : vouloir tout automatiser ; correction : commencer par augmenter sur les cas ambigus et sensibles.

- Erreur : mesurer seulement le volume de sessions ; correction : mesurer la résolution et la réitération par motif.

- Erreur : escalade vers l’humain sans contexte ; correction : transmettre résumé, motif, actions tentées et données collectées.

- Erreur : absence de transparence ; correction : annoncer l’IA, proposer une sortie vers humain, expliquer les limites.

- Erreur : intégrer trop tard le ticketing ou le CRM ; correction : planifier les intégrations dès le cadrage, même si elles viennent en lot 2.

- Erreur : absence de supervision continue ; correction : organiser une boucle d’amélioration avec revue, correction et re-mesure.

Bonnes pratiques de design conversationnel

La norme ISO 9241-210:2019 (Human-centred design for interactive systems) est un repère reconnu pour une démarche centrée utilisateur. Appliquée aux assistants conversationnels, elle rappelle une évidence : ce n’est pas la « meilleure IA » qui gagne, c’est le meilleur parcours pour vos clients et vos équipes.

- Clarté dès le départ : ce que l’assistant sait faire, et ce qu’il ne fait pas.

- Options explicites : proposer 2 à 4 choix, plutôt qu’une question ouverte répétée.

- Reformulation : valider l’intention avant de répondre sur un sujet sensible.

- Confirmation : vérifier les informations collectées avant un transfert ou une création de ticket.

- Sortie de secours : accès simple à un humain, sans punir le client.

- Cohérence : mêmes règles, mêmes réponses, même ton sur tous les canaux.

- Tests utilisateurs : scénarios réels, verbatims, itérations rapides.

Conclusion

À l’ère des assistants conversationnels, la stratégie IA relation client se résume à une équation simple : connaissance fiable, intégrations utiles, gouvernance réelle. C’est cette combinaison qui permet d’automatiser sans dégrader l’expérience, et d’augmenter vos conseillers là où leur jugement crée le plus de valeur. Démarrez petit, sur des motifs maîtrisés, mesurez avant et après, puis étendez par lots en durcissant les garde-fous. Si vous souhaitez réserver une consultation gratuite et avancer de façon structurée, un diagnostic et un atelier de cadrage, puis une formation IA pour le service client et le support, permettent généralement de passer plus vite du pilote à un usage durable.

FAQ

Faut-il démarrer par un chatbot client ou par un copilote pour les conseillers

En PME, démarrer par un copilote conseiller est souvent plus sûr : un humain reste responsable, et vous apprenez vite sur vos contenus. Un chatbot client devient pertinent quand vos motifs sont standardisés, votre base de connaissance est gouvernée, et l’escalade vers l’humain est fluide.

Quelles données faut-il pour qu’un assistant conversationnel réponde juste

Il vous faut une base de connaissance fiable, versionnée et attribuée à des propriétaires, plus les données de contexte nécessaires selon les motifs : statut de commande, historique, règles commerciales et procédures. Avec une approche RAG, l’assistant doit s’appuyer sur des sources internes autorisées et à jour.

Comment éviter les hallucinations et garder la maîtrise des réponses

Cadrez un périmètre clair, imposez l’usage de sources internes via RAG, et autorisez l’assistant à dire qu’il ne sait pas. Ajoutez des tests sur cas limites, un filtrage des sujets sensibles, et une supervision continue. Les cadres NIST AI RMF et NIST Generative AI Profile aident à structurer ces garde-fous.

Quels KPI suivre pour prouver le ROI sans biaiser les résultats

Suivez des KPI reliés à vos objectifs : déflexion utile, coût par contact, AHT, FCR, CSAT, effort client, conversion. Faites une baseline avant déploiement, segmentez par motif et contrôlez les effets secondaires, notamment la réitération et l’insatisfaction, pour éviter de conclure trop vite.

Quelles obligations de transparence s’appliquent en Europe avec l’AI Act

L’AI Act de la Commission européenne s’inscrit dans une logique de transparence et de gestion des risques. En pratique, prévoyez d’informer clairement l’utilisateur qu’il interagit avec une IA, de proposer une issue vers un humain et d’organiser la montée en compétence interne. La FAQ de l’AI Act Service Desk aide à traduire ces attentes en actions.